Enfoques y desafíos

Pablo Andrés Curarello

Resumen

Continuando en la línea de políticas basadas en evidencias, este artículo se enfoca en el abordaje de los desafíos de la evaluación de impacto (EI) para los institutos de ciencia y tecnología. Los procesos de observación, generación y uso de evidencia son particularmente importantes para el sector público. La EI es una herramienta clave para comprender en qué medida un determinado programa de acción para la implementación de una política logra su cometido. A su vez, observar los procesos de creación de impacto produce aprendizajes que mejoran la toma de decisiones y el desempeño de una institución.

El principal objetivo de este ensayo es facilitar el diálogo en el ámbito de los institutos de ciencia y tecnología sobre la importancia de las EI para la toma de decisiones de política basadas en evidencia. El trabajo le provee al lector una revisión sencilla de las estrategias y los métodos de EI, su conceptualización en pos de su institucionalización como práctica cultural y sus principales desafíos, y brinda una propuesta para su transversalización en los institutos de ciencia y tecnología, basada en la experiencia del camino recorrido por el INTA durante los últimos años en el marco del Proyecto Disciplinario Diseño e Implementación de un Sistema de Medición de Impacto del INTA sobre el sistema agropecuario, agroalimentario y agroindustrial (SAAA) argentino.

Para eso se propone dividir la lectura en cuatro partes. La primera de estas introduce al lector en la EI respondiendo preguntas como por qué evaluar impacto, qué ayuda a entender la EI, qué es impacto, cuándo medir, qué se necesita para llevar a cabo una EI, cómo responder a una pregunta de EI, para qué interesa medir impacto y desde dónde enfocarse a los fines de preparar a una institución de ciencia y tecnología para evaluar sistemáticamente su impacto. La segunda parte expone el enfoque de la EI haciendo un recorrido sobre conceptos claves como qué es evaluar, en qué consiste una EI, cómo se realiza y cuál es la importancia de gestionar por impacto. La tercera parte analiza cómo emprender EI en institutos de ciencia y tecnología. Para eso profundiza en cuáles situaciones se justifica desarrollar una EI, cómo gestionar por impacto, cuáles son los pasos indispensables para planificar el diseño de una EI, cuál es la mejor estrategia de diseño para una EI, cómo desarrollar estrategias de atribución causal y cómo lograr la apropiación de los resultados de una EI. Y la cuarta parte presenta los avances en la construcción de una estrategia metodológica para la transversalización de la EI en el INTA. Por último se brinda en anexo un cuadro síntesis que detalla referencias bibliográficas por temas considerados claves por el autor para la praxis de EI.

1. Introducción a la evaluación de impacto (EI)

Las EI forman parte de la agenda de investigación aplicada sobre la formulación de políticas públicas basadas en evidencia. Demostrar atribución de causalidad es el sello distintivo de esta evaluación. La EI investiga los cambios que provoca una intervención.

¿Por qué evaluar impacto en institutos de ciencia y tecnología?

Uno de los desafíos más apremiantes en materia de desarrollo es mejorar la capacidad de las instituciones de ciencia, tecnología e innovación para generar e internalizar aprendizajes sobre las políticas que ejecutan y sus estrategias de implementación en los territorios.

En este contexto, la EI es un instrumento clave para gestionar mejor, ya que sin evidencia precisa sobre cuán efectiva está siendo la política de ciencia y tecnología en lograr sus objetivos difícilmente se pueda mejorarla.

Por otro lado, la EI trasciende la medición de programas específicos y pone en valor los sistemas de información y estadísticas para la toma de decisiones, produciendo mejoras sobre los procesos de sistematización de datos administrativos, monitoreo y evaluación de proyectos.

A medida que la EI va convirtiéndose en una herramienta de uso generalizado en la institución, transforma la práctica laboral en una cultura de aprendizaje clave para el mejoramiento continuo y sostenible de la gestión tanto pública como privada.

¿Qué ayuda a entender la EI?

La EI ayuda a entender cómo provocar mejores impactos a partir de estrategias focalizadas para subgrupos o dimensiones distintas para los cuales los productos y servicios brindados a la sociedad son la respuesta a necesidades, demandas y oportunidades.

¿Qué es impacto?

El Comité de Asistencia para el Desarrollo de la Organización para la Cooperación y el Desarrollo Económicos (OCDE o también OECD, por sus siglas del inglés Organisation for Economic Co-operation and Development) define impacto como los “efectos positivos y negativos, deseados y no deseados, directos e indirectos, primarios y secundarios, que produce una intervención”.

¿Cuándo medir?

Lo importante es medir en lo cotidiano. Lograr introducir al INTA en la práctica habitual de la captura de la propia información que genera en el proceso de producción de valor público es un recurso valioso tanto para el seguimiento de la labor institucional como para la evaluación de su impacto.

¿Qué necesitamos para llevar a cabo una EI?

En primer lugar, conocer en profundidad la intervención que se quiere evaluar y poder formular hipótesis de interés sobre mecanismos causa-efecto provocados por la institución, que se vinculan con las variables de resultado esperadas, en proceso u observadas.

En segundo término, preguntas específicas de relevancia estratégica sobre los impactos que interesa provocar (anticipación), analizar su proceso de construcción (predicción) y evidenciar sus efectos (comprobar). ¿Para qué? Para seleccionar la mejor alternativa de proyecto de intervención y de estrategia de gestión, mejorarla (realizar ajustes y reprogramación) y aumentar la eficacia de carteras programáticas futuras.

Y tercero, fuentes de información adecuada para una investigación evaluativa del impacto que responda a la hipótesis y la pregunta planteadas (bases de datos institucionales y sistemas de relevamiento de información primaria, para un análisis mixto cuali-cuanti).

¿Cómo responder a una pregunta de EI?

Para esto es fundamental reflexionar sobre cuatro aspectos claves:

- Analizando si la intervención provoca los impactos esperados sobre los destinatarios tanto en dirección (¿son positivos o negativos?) como en magnitud (¿son mayores o más efectivos para algún subgrupo de destinatarios?).

- Si el resultado evidenciado (esperado o no esperado) es atribuible a los mecanismos de intervención provocados por la institución.

- Si la intervención puede ser mejorada o rediseñada para provocar mayor impacto.

- Si se evidenciaron efectos no previstos. En caso afirmativo, ¿externalidades positivas o negativas?, ¿sobre los propios destinatarios u otros grupos de la sociedad?

Sintetizando, ¿para qué interesa medir impacto?

Sobre todo, para incidir en los procesos de toma de decisiones, para lo cual –según el caso– es fundamental contar con EI ex ante (“con anterioridad”), concurrente y ex post (“a partir de”). En el caso de las instituciones de ciencia y tecnología, es fundamental la generación de evidencia de impacto para realimentar el direccionamiento estratégico hacia una mayor efectividad en el desarrollo.

Dentro de las principales decisiones a considerar se destaca la importancia sobre a cuáles proyectos destinar recursos (humanos, financieros, físicos, tecnológicos, naturales y energéticos) a los fines de provocar un mayor impacto.

En este sentido, las EI brindan un conocimiento clave para decidir si es conveniente o no financiar una intervención o si es recomendable continuar con esta o ampliarla. También brinda aprendizajes sobre cómo replicarla a partir de una experiencia piloto y sobre cómo adaptar satisfactoriamente una intervención exitosa para otro contexto.

Por otro lado, en términos de responsabilidad social se analiza qué funciona y qué no, lo cual mejora los procesos de implementación de futuras intervenciones, y se les informa a los destinatarios cuánto o si no se está beneficiando a la comunidad y en qué forma se lo hace.

El principal desafío es promover la consolidación de una huella de conocimiento más profunda que contribuya con un proceso de toma de decisiones cada vez más basado en evidencia, a partir del cual la EI se convierta en una herramienta de uso generalizado en las instituciones públicas.

¿Desde dónde enfocarse a los fines de preparar a una institución de ciencia y tecnología para la EI?

El impacto de la ciencia y la innovación está enfocado en la transformación o el conjunto de cambios sostenibles producidos en las distintas dimensiones del desarrollo para mejorar sus indicadores y categorías de análisis en beneficio del ser humano, la economía, la sociedad y el ambiente, como resultado de las agendas I+D+i.[1] Siempre que se vayan a destinar esfuerzos para producir resultados en ciencia e innovación, es imprescindible valorar con anterioridad su posible impacto (evaluación ex ante), analizar los procesos de coconstrucción por los cuales se provoca (evaluación concurrente) y evidenciar sus efectos positivos y negativos, previstos e imprevistos, con la mayor objetividad posible (evaluación ex post).

La EI comprende un análisis multidimensional –social, económico y ambiental– que requiere integrar las diferentes perspectivas de los destinatarios. Por un lado, evaluar el impacto desde la perspectiva de las modificaciones al ambiente ocasionadas por la intervención. Por otro, la medición sobre el valor agregado en la producción, y la generación de ingresos y empleo, entre otras variaciones provocadas en la economía de los destinatarios. Finalmente, valorar los posibles cambios y las consecuencias sociales sobre la población: nuevos comportamientos de vida comunitaria, prácticas productivas, formas de organización, creencias y valores, entre otras.

Para eso es esencial introducir a las instituciones en un proceso de transversalización de la EI. La transversalización es una estrategia para conseguir que la EI sea parte integrante en la elaboración, la puesta en marcha, el control y la evaluación de toda acción institucional. Es un proceso de aprendizaje y transformación de cultura institucional orientado a promover y sustentar un ecosistema de medición y gestión del impacto; un proceso de aprendizaje, construcción y comunicación que propicie un trabajo coordinado y cooperativo entre destinatarios y protagonistas para observar, entender y valorar los procesos de creación de impacto en marcha y evidenciar los cambios provocados.

2. El enfoque de la EI y la importancia de gestionar por impacto

Un primer aspecto clave a destacar es que interesa la EI para “conocer si la realidad que intervenimos funciona como presuponemos”.

Frecuentemente se observa que las decisiones sobre los recursos públicos se basan en determinadas ideas que algunas personas tienen sobre cómo funciona el mundo. Habitualmente, estas creencias se fundamentan en experiencias personales, trayectorias profesionales y la manera en que habitualmente suelen hacerse las cosas, pero pocas veces se basan en evidencias.

El desafío de la EI es mostrar qué hubiese sucedido con la vida de las personas destinatarias de una intervención (acceso a una determinada tecnología o estrategia de desarrollo, entre otras) en el mundo alternativo en el cuál ellas no hubiesen sido partícipes de ella. Y conocer –a partir de ello– cuál es el cambio provocado por la intervención sobre determinados resultados de interés.

¿Por qué? Porque interesa evidenciar si las lógicas y rutas de acción que se planifican y ejecutan son adecuadas para producir las transformaciones deseadas. Esto cobra vital importancia en los tiempos actuales, cuando la incertidumbre, la multidiversidad, lo paradójico y lo contradictorio rigen las dinámicas de nuestras interacciones.

¿Se está pudiendo responder a las necesidades, los problemas, las demandas y las oportunidades que emergen del sistema agropecuario, agroalimentario y agrobioindustrial (SAB)? ¿Son adecuados los modelos de intervención frente a la complejidad de los contextos actuales? ¿Cuáles son los efectos observables provocados por los productos y servicios brindados por los institutos de ciencia y tecnología ante una era de constantes cambios? Para dar respuestas a estas y otras preguntas claves de la planificación del desarrollo, la EI cumple un rol fundamental como herramienta de gestión para la toma de decisiones basada en evidencia y la creación de procesos de alto valor público.

¿Qué es evaluar?

La evaluación es una investigación y –como tal– requiere de rigurosidad científica para que los juicios de valor resultantes estén basados en evidencias que permitan responder de manera técnica y precisa a los interrogantes estratégicos que la motivan.

El fundamento teórico detrás de una evaluación es el concepto de cambio que se produce por la intervención. Las preguntas de investigación que pretenden responder y evidenciar las EI son “preguntas de causa y efecto”, se centran en estudiar la atribución de causalidad.

La EI no busca responder “preguntas descriptivas ni normativas”, razón por la cual no es su finalidad sistematizar lo que está ocurriendo (evaluación descriptiva) ni comparar lo que ocurre con lo que debería ocurrir (evaluación normativa). Las EI se ocupan de estudiar los cambios “atribuibles” a una intervención, modalidad de implementación o innovación de diseño, sobre un resultado de interés específico.

La EI de un proyecto, programa o política pública busca evidenciar aquellos cambios sostenibles en el tiempo que resultan de una acción específica dirigida a transformar la realidad.

Su objetivo es valorar el “diferencial de cambio” entre la situación con intervención versus la situación sin intervención. La intervención puede ser un proyecto pequeño, un programa grande, una colección de actividades, una serie de comportamientos, un lineamiento estratégico o una política a escala local, regional, nacional o internacional.

Sintetizando, ¿en qué consiste una EI?

Una EI consiste en:

- Identificar con precisión las hipótesis que subyacen a la lógica de cambio en función de las preguntas de evaluación.

- Verificar si estas hipótesis se han cumplido en la práctica.

- Identificar aquellos efectos no planificados ni previstos.

- Identificar otras intervenciones o factores que pudieran haber influido en los cambios producidos.

- Garantizar que los impactos identificados (planificados, no planificados y no previstos) sean efectivamente consecuencia de la intervención realizada.

¿Cómo se hace eso?

Básicamente, intentando responder a tres preguntas fundamentales (Watson, 2008): ¿qué cambios ha habido en las personas destinatarias y su comunidad desde el inicio de la intervención?, ¿cuáles de estos cambios son atribuibles a ella?, y ¿qué diferencia han marcado estos cambios en la vida de la población (destinataria directa e indirecta)?

Para eso es importante que el proyecto de intervención a evaluar se haya formulado o se pueda reformular bajo el enfoque de una teoría del cambio, reflexionando sobre: ¿adónde se quiere llegar en el largo plazo?, ¿qué se quiere lograr a mediano plazo?, ¿qué se quiere lograr a corto plazo? y ¿qué hacer para conseguir estos cambios? Y, a partir de las respuestas que surjan a estas preguntas, profundizar sobre las oportunidades de transformación en las cuales intervenir. Dentro de las principales podemos identificar los “cambios proyectables y transformativos” (Retolaza, 2009).

Los “cambios proyectables” son aquellos que surgen de brindar solución tecnológica a problemas simples o complicados a partir de una lógica lineal mediante proyectos concretos y acciones planificadas. Mientras, los “cambios transformativos” se refieren a las prácticas transformadoras de Pierre Bourdieu (1997), a aquellas acciones que permiten liberarse de modelos mentales, ideologías, círculos viciosos y demás elementos que obstaculizan la posibilidad de materialización de nuevas realidades y futuros deseados.

La definición sobre cuál categoría de cambio se va a construir la intervención es clave para proyectar su alcance en cuanto a metas de resultado e impacto, y analizar cómo se producirán los vínculos de causalidad. Si los cambios a provocar son proyectables, es esperable plantear una lógica de “atribución causal exclusiva” como estrategia de intervención. Si se corresponde con los cambios transformativos, la estrategia requerirá al menos una lógica de “atribución causal conjunta” a otras intervenciones. Cuando el objetivo es la contribución al desarrollo de los territorios se reconoce que confluyen “vías causales alternativas (o múltiples)”. Identificar la forma como se produce el cambio esperado es fundamental para dimensionar el alcance de la intervención y poder demostrar su estrategia de atribución-contribución sobre las metas de impacto.

¿Gestión por impacto? ¿Qué significa?

Las instituciones de ciencia y tecnología gestionan por impacto cuando asumen como objetivo estratégico promover, observar y gerenciar sus procesos de creación de impacto.

Esto implica medir el impacto de la labor institucional en forma continua, propiciando aprendizajes que permitan identificar y definir acciones correctivas si los resultados se desvían de lo esperado.

La gestión del impacto requiere:

- Construir una “visión compartida de futuro” –desde la población destinataria y los stakeholders o partes interesadas– que explicite las expectativas y previsiones de futuro sobre el proceso de creación de impacto que se quiere desencadenar para transformar la realidad y sus efectos sobre la complejidad del SAB.

- Tener una “visión estratégica” –desde la organización– en lo que se refiere al problema o la necesidad a abordar, la misión a la que servir, las relaciones institucionales que promover, la creación de valor público a provocar y el sistema de información sobre los resultados de impacto a comunicar.

- Una “visión operativa” –desde los proyectos, los programas y la política pública– con la que se trabaje en cómo provocar mayor y mejor impacto a partir de las respuestas brindadas ante las demandas, necesidades y oportunidades, presentes y futuras, del SAB.

Todo eso forma parte de la gestión del impacto, que se concibe como un proceso circular de “mejora continua” a partir del cual se contrastan los resultados de la labor institucional con:

- Lo que hubiese pasado de todas formas (efecto “peso muerto”).

- Las actividades de otros agentes (aislar lo atribuible al proyecto de intervención).

- En qué medida los efectos de la intervención inicial van perdiendo importancia con el paso del tiempo (efecto “caída”).

- En qué medida los resultados han desplazado otras consecuencias igualmente positivas que hubieran podido suceder (efecto “desplazamiento”).

- Las consecuencias inesperadas o imprevisibles (que pueden ser positivas o negativas).

Para abordar la complejidad que implica gestionar por impacto, existe una amplia gama de enfoques útiles: simulación ex ante, construcción de escenarios, juegos de toma de decisiones, monitoreo orientado a impactos, prospectiva estratégica y pensamiento complejo, entre otros. Como se puede apreciar, el uso de métodos participativos se torna cada vez más una cuestión fundamental, ya que permiten valoraciones cualitativas para contar lo incontable, generar estadísticas de dimensiones pertinentes y analizar categorías de las percepciones y creencias de los stakeholders que de otro modo quedarían reducidas en cuanto a su relevancia.

3. Emprendiendo EI en institutos de ciencia y tecnología

Las EI deberían “utilizarse selectivamente” en función de decisiones de política institucional o cuando la pregunta de evaluación que se plantea es específica y exige un exhaustivo análisis de la causalidad para el direccionamiento estratégico.

¿En cuáles situaciones se justifica desarrollar una EI?

Para estudiar los efectos de atribuibles a:

- Un nuevo y prometedor proceso de innovación.

- Las condiciones de replicabilidad de una intervención a otra escala, grupo y entornos diferentes.

- Ampliar el alcance de una intervención, reformarla o justificar su modificación presupuestaria.

- Una intervención no probada, de la cual se conoce poco sobre sus impactos.

- Fundamentar una decisión de política institucional basada en evidencia.

Por ejemplo, la reorientación de los rumbos de una Estación Experimental Agropecuaria del INTA frente a la actualización de cambios de contextos y nuevas visiones de éxito, la negociación de la asignación del gasto público, nuevas estrategias de intervención de un programa nacional por la emergencia de nuevas problemáticas, la priorización de recursos presupuestarios y la formulación de una nueva cartera de instrumentos programáticos, entre otros casos.

¿Cómo gestionar por impacto?

Se debe considerar que existen tres tipos de proyectos a formular y, por ende, tres tipos de evaluaciones de diseño a realizar: por un lado, el diseño del “proyecto de la intervención”, ejercicio que se realiza ex ante; por otro, el diseño del “proyecto de evaluación de la intervención” y, además, el diseño del “proyecto de evaluación de la EI” (metaevaluación), ejercicios que pueden realizarse tanto ex ante como ex post.

Es importante organizar el ecosistema de innovación por impacto a los fines de trabajar conjuntamente ex ante esos diseños, ya que esto permite la anticipación estratégica sobre la magnitud y la intensidad de los cambios programados. Y dejar para un ejercicio ex post el diseño de ajuste y reformas al proyecto de evaluación de la intervención y de la metaevaluación. Para eso es fundamental introducir a la institución en el enfoque de la EI prospectiva.

La EI prospectiva se programa, diseña e inicia su ejecución junto al proceso de formulación y puesta en marcha de la intervención. Se sustenta en las estrategias de atribución causal y metodologías de evaluación que anticipan y que no anticipan los efectos de la intervención (impactos previstos y no previstos, métodos deductivos e inductivos). Su característica más importante es la posibilidad de construcción de un escenario contrafactual a partir de un grupo de comparación y del análisis de coherencia de los datos empíricos. A su vez, este enfoque posibilita establecer línea de base, promueve la construcción de una teoría de cambio, procura la utilización de técnicas cuali-cuanti, permite la simulación ex ante y anticipar la magnitud del impacto, y potencia el aprendizaje social y la mejora continua para la gestión y comprensión de los procesos de desarrollo.

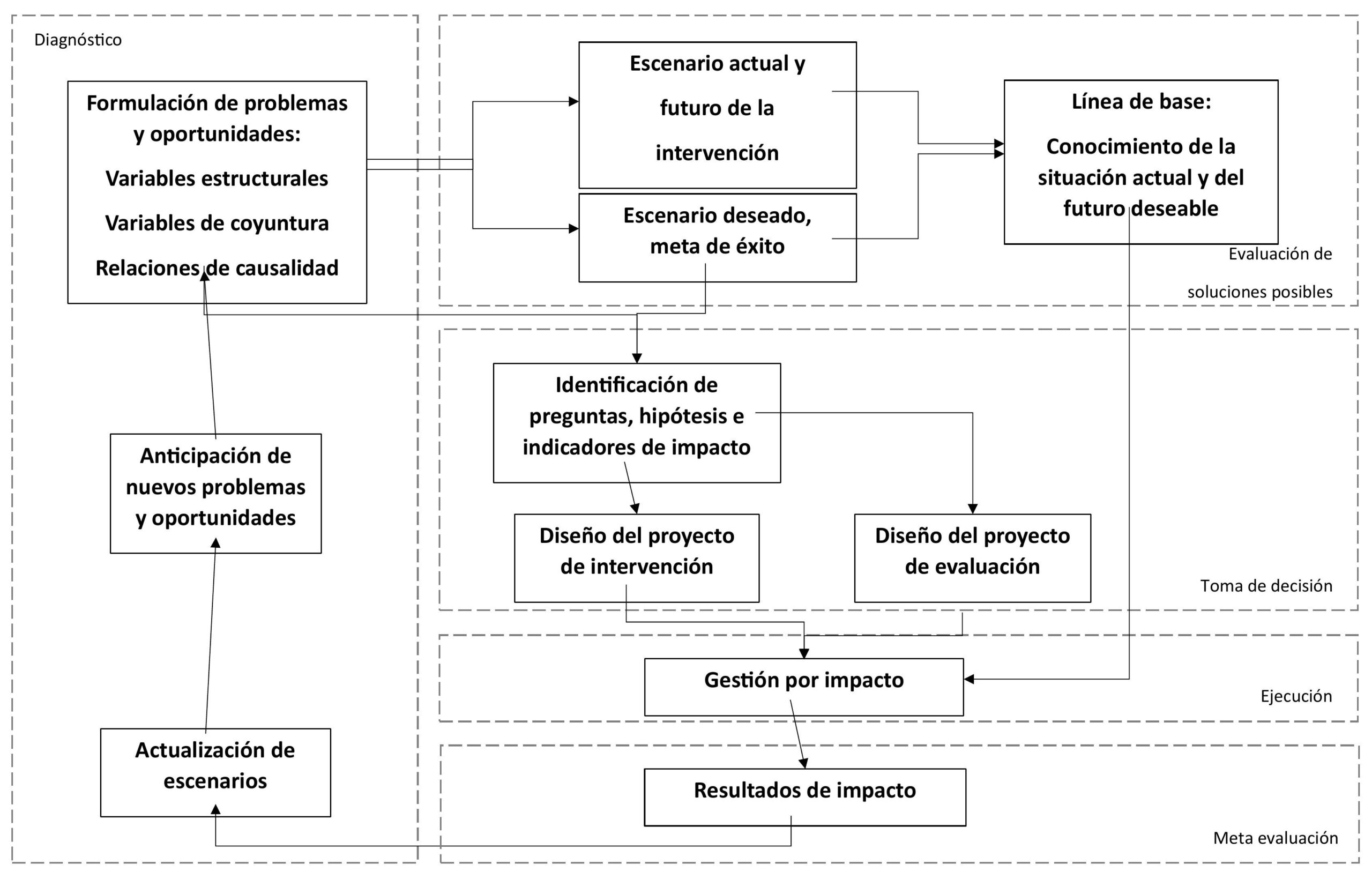

Diagrama 1: Esquema de la lógica causal de un proceso de gestión del impacto

Fuente: elaboración propia (Curarello, 2021).

El principio ético más básico en una EI es que las reglas de operación pertenecen a la estrategia de implementación de la intervención, no son impuestas por el diseño de evaluación, sino que este se ajusta a ellas. Planificar el diseño de la EI es útil para dilucidar y clarificar las reglas de operación del programa, y contribuye a analizar si son equitativas y transparentes, y si se sustentan sobre la base de criterios claros de elegibilidad.

A su vez, la ética de la EI excede a la ética de las reglas de operatoria e implementación de la intervención, introduciéndose en la ética de la investigación humana y social que implica llevar a cabo investigaciones transparentes, objetivas, reproducibles y –en la medida de lo posible– generalizables.

Los pasos indispensables para planificar el diseño de una EI son:

- Explicitar y construir participativamente una lógica de cambio (o realizar su reconstrucción histórica) que contemple las alternativas de cómo se supone (creencias, modelos mentales, teorías o evidencias de experiencias similares) que la intervención logrará los objetivos previstos.

- Acordar el camino hacia el impacto (especificar la estrategia de atribución causal).

- Definir las preguntas de EI en función de la intencionalidad del estudio y los aprendizajes institucionales a propiciar.

- Seleccionar los indicadores para medir, valorar y analizar el diferencial de cambio.

Estos pasos requieren de un marco amplio de participación, con todos los involucrados (equipo de la intervención, población destinataria y stakeholders, entre otros), que permita construir un lenguaje común y una visión compartida de la transformación esperada y la forma de alcanzarla.

Hay que acordar y comunicar cómo se gestionará la evaluación, los equipos de trabajo, quiénes tomarán cada tipo de decisión y cómo se garantizará su calidad.

Para conformar el equipo se deberán explicitar los términos de referencia de la investigación y definir las competencias básicas para desarrollarla. Los términos de referencia deben especificar por qué se realiza la evaluación, quién utilizará la evaluación, cuál es la teoría del cambio que sustentó la acción, las preguntas estratégicas que motivan la evaluación, los criterios a partir de los cuales se emitirán los juicios de valor y los recursos que se disponen para llevarla a cabo. El equipo constituido debe ser multidisciplinario, con experiencia en el diseño y el análisis de indicadores, con presencia de un experto metodológico y expertos temáticos en el área de la intervención.

¿Cuál es la mejor estrategia de diseño para una EI?

Actualmente se cuenta con una gran diversidad de herramientas y métodos para una investigación evaluativa situada a las características, la complejidad y el contexto de la intervención. No existe una estrategia única y predefinida para EI, sino una diversidad de opciones que permiten comprender y demostrar atribución de causalidad.

Según se busque anticipar o no los efectos de una intervención, se configuran dos estrategias claramente diferenciadas y complementarias de trabajo.

En primer lugar, en el marco de la EI prospectiva, cuando se “anticipan” y definen los posibles efectos –positivos y negativos– junto a la evaluación de diseño de la intervención. Esta estrategia se focaliza en los impactos (previstos) que surgen de la lógica de cambio establecida para responder al problema u oportunidad que dio origen a la intervención. Permite la utilización de métodos cuantitativos de evaluación. Se basa en el método deductivo de investigación; ex ante se formulan hipótesis sobre los mecanismos causales preestablecidos para provocar el cambio y ex post se recolecta información para determinar si efectivamente se produjeron o no. El estudio se respalda en el enfoque del pensamiento contrafactual.

En segundo término, cuando la estrategia “no busca anticipar” los efectos o no se ha realizado ex ante la definición de las variables de impacto. Esta alternativa se enfoca en valorar tanto los efectos –positivos y negativos– previstos como los no previstos por la intervención. Permite centrar el análisis en los mecanismos que producen los efectos y en el contexto en que estos ocurren, pasando a un plano posterior la cuantificación del efecto neto de la intervención. La importancia de esta estrategia radica en que los efectos no previstos de la intervención muchas veces son más importantes que aquellos identificados anticipadamente.

La complementariedad entre ambas estrategias es fundamental para ampliar la gama de los impactos observados a partir de la identificación de efectos no previstos provocados por la intervención.

A su vez, en función de cuáles son las reglas de selección de la población destinataria de la intervención y cuál el grado de información disponible, suele enfocarse el diseño de la EI a partir de tres tipos de estrategias que permiten evidenciar el grado de atribución causal:

- Enfoques contrafácticos: requieren de la construcción de un escenario contrafactual a partir del cual se calcula el diferencial de cambio entre la estimación de lo que habría ocurrido en ausencia de la intervención y lo que se ha observado como resultado de su ejecución. Se planifica a partir de diseños experimentales, cuasiexperimentales o no experimentales.

- Análisis de la coherencia de las pruebas empíricas con la relación causal: son procesos de investigación que definen y estudian patrones que serían coherentes con una relación causal; patrones que normalmente se basan en la construcción o reconstrucción histórica de la teoría del cambio que orientará la creación de impactos o qué los produjo, para confirmarlos o desmentirlos con la evidencia empírica generada.

- Descarte de explicaciones alternativas: en este enfoque se definen explicaciones alternativas posibles de haber producido el impacto de la intervención y a continuación se recopilan los datos necesarios para poder descartarlas. Esta estrategia resulta especialmente útil cuando las pruebas disponibles sólo pueden indicar “correlación”, pero no “causalidad”.

Procurar un diseño de complementariedad entre ellas es clave para demostrar el vínculo de conexiones verificables entre el cambio producido y la intervención.

Dentro de los principales desafíos a considerar cabe mencionar primero que cada elección de metodología arrojará un tipo de resultado diferente, con lo cual aparece una tensión entre legitimación y motivación sobre los resultados de impacto esperados. Por esta razón es necesario lograr establecer una alineación estratégica de la labor institucional en términos de impacto, que no solo defina las acciones significativas a observar, sino que además brinde información sobre los avances en torno a las transformaciones a provocar. A esto se suma la necesidad de una mirada integral desde donde especificar e implementar una serie de mecanismos sistemáticos efectivos para planificar y evaluar el impacto de una institución.

Otro desafío esencial para considerar es que la EI implica un trabajo extra que –a la hora de llevarlo a la práctica, más allá de las motivaciones personales– nadie quiere asumir. Ahora, si se establece un esquema de decisiones centralizadas para la EI, de abajo hacia arriba, se puede proyectar una labor focalizada a partir de métodos experimentales que no requieran que una misma persona siempre brinde información. Se puede abordar un esquema de selección y recorte a partir de una muestra teórica, con un protocolo normalizado para la recolección de la información, a partir del cual se decida a quiénes les toca completar ese requerimiento cada año, alternando entre sí.

Esto conlleva cambiar el enfoque sobre qué es importante medir. En general persiste un énfasis en el monitoreo y la evaluación de productos y servicios, y no tanto en sus efectos e impacto sobre para qué estos se desarrollan y brindan a la sociedad.

Estratégicamente, a la hora de implementar un sistema de EI se tienen que abordar simultáneamente los siguientes desafíos:

- Asumir la EI como estrategia de comunicación y legitimación de la acción institucional.

- Lograr motivar a todo el personal para que sea parte de los procesos de EI, cada quien desde su rol.

- La simpleza en los requerimientos de EI y los instrumentos de recolección de información a utilizar.

- Un uso responsable de la evidencia de impacto en los procesos de toma de decisiones.

- La necesidad, para todo eso, de construir una cultura de gestión por impacto.

Para lograr apropiación es crucial transversalizar la EI en la institución, a la vez que diseñar y explicitar un marco organizacional consistente con la dinámica del ecosistema de innovación por impacto propuesto. De igual modo, lograr un trabajo de síntesis que a partir de las experiencias de EI permita nutrir la toma de decisiones basada en evidencia, valorizando el acervo del conocimiento generado para el aprendizaje integral de la institución y el diseño de nuevos proyectos, programas y políticas.

4. Avances en la construcción de una estrategia metodológica para la transversalización de la EI en el INTA

En la búsqueda de conseguir que la EI sea parte integrante en la elaboración, la puesta en marcha, el control y la evaluación de toda acción del INTA, se requieren:

- Una reflexión personal y colectiva que interpele las prácticas, las ideas previas y las resistencias propias.

- Revisión, diseño e implementación del enfoque y el marco organizacional propuesto para implementar el ecosistema de EI.

- Alianzas estratégicas con actores referentes en EI.

- Abordaje de lo que la práctica de la EI irrumpe en el mundo laboral, como tarea adicional para su abordaje.

- Organización de la cultura laboral en transformación hacia una cultura de impacto.

Para eso, asumiendo la estructura matricial del INTA y en función de quiénes tomarán las decisiones sobre qué es clave evaluar y para qué, se proponen “dos estrategias complementarias”: coordinar la gestión por impacto tanto de arriba hacia abajo como de abajo hacia arriba.

La primera –de arriba hacia abajo– implica establecer mecanismos sistemáticos efectivos para planificar y evaluar el impacto institucional a partir de toma de decisiones centralizadas, que aseguren los procesos de selección y recorte en torno a la priorización de ejes estratégicos por parte de la estructura de gobernanza vigente. La segunda –de abajo hacia arriba– conlleva poner el foco en las motivaciones personales y los desafíos asumidos localmente, buscando provocar un efecto multiplicador de la EI entre el personal del INTA.

¿Para qué? Para promover una cultura del impacto.

¿Entre quiénes? Tanto entre directores y coordinadores, como hacia todo el personal de la institución.

¿Desde quiénes? Desde la comunidad de práctica INTA en EI.

¿Con cuál finalidad? Generar comunidades de aprendiencia en EI en torno a ambas estrategias.

¿Cómo? Coordinando y satisfaciendo las necesidades de trabajo en red que implica transversalizar la EI en el INTA.

¿A que nos referimos al hablar de comunidades de aprendiencia? El concepto “aprendiencia” se utiliza para referirse a “estar en proceso de aprender”. En función de promover una cultura del impacto y transversalizar la EI en el INTA se propone caminar en este sentido con el objetivo de trazar un antecedente hacia la conformación de comunidades de aprendiencia en los territorios, conjugando la acción colectiva, con un propósito en común: crear, observar y medir impacto.

Conceptualizamos al sistema de medición de impacto como un observatorio en red de observatorios, cuyo propósito es “observar la construcción de los impactos del INTA, evidenciando la capacidad de la institución para generar cambios o variaciones” en una población objetivo. En otras palabras, valorar la virtud del INTA para contribuir a solucionar las situaciones problemas identificadas (abordaje y anticipación de demandas, necesidades y oportunidades del SAB).

¿Qué implica? En principio, toma de decisiones centralizada, donde “lo estratégico prima sobre lo participativo”. Seguidamente, trabajo cooperativo y en red.

¿A qué nivel? Un ecosistema de gestión por impacto a nivel dirección nacional y otros a nivel centros regionales y de investigación.

¿Por qué? Para garantizar sinergia entre las tres escalas priorizadas de EI en las cuales se propone estructurar el sistema:

- EI integral: ¿cuál es el plus del INTA como institución para el desarrollo del SAB?

- EI transversal: implica selección y recorte de acciones transversales a nivel agregado. Requiere establecer un protocolo estandarizado de medición, diseño ex ante, información continua y evaluación centralizada, entre otros aspectos.

- EI de unidades primarias: implica que proyectos y unidades puedan diseñar su proyecto de EI a partir de mecanismos sistemáticos. Demanda trabajar y articular en red oportunidades y desafíos de EI específicos e instaurar la EI en la estructura de gobernanza y sus carteras programáticas.

¿Cómo? Se propone seleccionar una muestra teórica de las acciones a EI, bajo el criterio de brindar un mayor aprendizaje y evidencia para toma de decisiones estratégicas en lugar de una selección de carácter representativa de la cartera de instrumentos programáticos.

A su vez, los indicadores deben seleccionarse con el propósito de dar cuenta de los impactos a nivel integral del INTA, centrándose en un conjunto completo de ellos que reflejen los objetivos estratégicos articulados en alineación con los planes de centros y programas, el Plan de Mediano Plazo y el Plan Estratégico Institucional. Esta priorización de indicadores en función de los aprendizajes propicia un análisis profundo a lo largo de la cadena causal del INTA, integrando las teorías del cambio que evidencian su accionar.

Poner en agenda la EI requiere de un análisis sistemático que permita comprender el impacto potencial de la labor institucional para maximizarlo. Por otro lado, los mecanismos sistemáticos instrumentados para la EI deben ser creíbles y confiables, para lograr legitimidad. Para eso es clave trabajar la EI desde la etapa de diseño de sus instrumentos programáticos (EI prospectiva), coordinando el relevamiento de información para las tres escalas de análisis por protocolos estandarizados. Esto es fundamental para asegurar que las teorías de cambio estén articuladas en alineación estratégica sobre la misión institucional.

¿Cómo provocar oportunidades de EI sobre toda la estructura matricial del INTA? La Red Impacto INTA y los Nodos de Investigación Evaluativa: su propósito es provocar el efecto multiplicador necesario para impulsar la transversalización de la EI.

Su objeto es:

- Canalizar demandas y necesidades descentralizadas de EI (formación, práctica evaluativa, información, identificación de propuestas de EI y sus diseños metodológicos).

- Relacionar y potenciar las capacidades institucionales (articular y coordinar personas, perfiles técnicos y recursos financieros, físicos e informáticos para la EI).

- Acompañar las iniciativas locales, generar espacios de reflexión (seminarios y jornadas, talleres, entre otros).

- Establecer una estrategia de comunicación para valorizar lo que se hace a nivel macro.

- Generar procesos de síntesis (repositorio de experiencias, aprendizajes, metodologías y reportes periódicos, entre otros).

5. Conclusión

El desarrollo de una agenda política de ciencia y tecnología a nivel nacional es una labor compleja. A su vez, las limitaciones de recursos y apremiantes necesidades que involucran el proyecto de desarrollo de un país hacen que sea una actividad tanto estratégica como crítica. Es apremiante poder promover ecosistemas de innovación de impacto. La ciencia y la tecnología requieren de una política pública capaz de comprender su complejidad e incentivar agendas I+D+i que maximicen su impacto. Para esto es necesario desarrollar una capacidad institucional pasible de capitalizar los resultados disponibles de las EI y el uso de la evidencia para el direccionamiento estratégico de la política. La EI de la política en ciencia y tecnología establece un sistema determinado de incentivos, creencias y comportamientos esperados que se alinean naturalmente en la construcción de un futuro específico. La gestión por impacto orienta los procesos de cocreación para que el futuro en construcción se aproxime al futuro deseado.

Se espera que los enfoques, las reflexiones y los desafíos aquí planteados sean significativos en el desarrollo y la profundización de las acciones del INTA y de otras instituciones de ciencia y tecnología que quieran contribuir a un proceso de transformación hacia una cultura de EI. Y que a su vez sean reveladores para fomentar el uso de la medición de impacto y la experimentación social como herramienta de gestión pública, e impulsen la consolidación de nuevos procesos de investigación evaluativa que promuevan métodos de toma de decisiones cada vez más basados en evidencia.

Bibliografía

Aldunate, E. (2010). Evaluación de Gestión, Resultados e Impactos de Programas Públicos. Curso internacional: Planificación Estratégica y Políticas Públicas. ILPES-CEPAL. La Antigua, Guatemala.

Arenas Caruti, D. (2019). Evaluación de Programas Públicos. Instituto Latinoamericano y del Caribe de Planificación Económica y Social, (ILPES). Santiago de Chile.

Ávila, D., y Sain, G. (2007). Evaluación de los impactos potenciales de los proyectos financiados por el FONTAGRO 2da y 3ra convocatorias / IICA, FONTAGRO – San José, C.R.: IICA.

Baker, J. L. (2000). Evaluating the impact of development projects on poverty: a handbook for practitioners. Banco Internacional de Reconstrucción y Fomento/Banco Mundial. Washington D. C.

Barret, D.; Blundo-Canto, G.; Dabat, M. H.; Devaux-Spatarakis, A.; Faure, G.; Hainzelin, E.; Mathé, S.; Temple, L.; Toillier, A.; Triomphe, B., y Vall, E. (illus.): “Guía metodológica Impress: evaluación ex post de los impactos de la investigación agrícola en los países en desarrollo”, Montpellier, Francia, Centre de Coopération Internationale, en Recherche Agronomique pour le Développement 96, ISBN: 978-2-87614-744-7, 2018. https://doi.org/10.19182/agritrop/00064.

Bello, R.: Curso-taller Evaluación de Impacto, Módulo 3, Instituto Latinoamericano y del Caribe de Planificación Económica y Social – Comisión Económica para América Latina y el Caribe, Santiago de Chile, 2009.

Blasco, J., y Casado, D.: “Guía práctica 5”, Evaluación de Impacto Colección Ivàlua de Guías Prácticas sobre Evaluación de Políticas Públicas, Ivàlua, Cataluña, España, 2009.

Bourdieu, P.: Razones prácticas: sobre la teoría de la acción, Barcelona: Anagrama, 1997.

Causemann, B.; Gohl, E.; Brenner, V., y Rithaa, M. (ONG-IDEA): Medición del cambio en comunidades y grupos, 2010. Recuperado del sitio web: http://www.dochas.ie/Shared/Files/4/NGO_Ideas_Tiny_tools-Handout [1font>.pdf.

Chambers, R.; Karlan, D.; Ravallion, M., y Rogers, P.: “Diseño de evaluaciones de impacto: perspectivas diversas”, Working Paper 4. International Initiative for Impact Evaluation, c/o Global Development Network, Nueva Delhi, India, 2009.

Consejo Nacional de Coordinación de Políticas Sociales, Presidencia de la Nación: “El Consejo Nacional de Coordinación de Políticas Sociales y la Evaluación”. II. Tipos de evaluación, Ciudad Autónoma de Buenos Aires, Argentina, 2019.

Corporación Financiera Internacional (CFI): Manual de buena práctica. Evaluación y gestión de impactos acumulativos: guía para el sector privado en mercados emergentes, Washington D. C., 2015.

Crespi, G.; Maffioli, A.; Mohnen, P., y Vásquez, G.: “Evaluating the impact of science, technology and innovation programs: a methodological toolkit inter-american. Impact-Evaluation Guidelines”, Technical Notes N.º IDB-TN-333, Development Bank, Washington D. C., 2011.

Curarello, P. A.: “Principios y criterios mínimos para proyectar la medición de impacto en el INTA”, en Serie Estudios Socioeconómicos de la Sustentabilidad de los Sistemas de Producción y Recursos Naturales, INTA, Proyecto Disciplinar I208 Diseño e Implementación de un Sistema de Medición de Impacto del INTA sobre el SAAA, Argentina, ISSN 1851-6955, N.º 19, 2020.

Curarello, P. A.; Calamante, G.; Claps, L. L.; Pérez, G. A.; Rozenblum, C., y Martínez, M. J.: “Aportes para la construcción de una propuesta de medición de impacto en el INTA”, en Serie Estudios Socioeconómicos de la Sustentabilidad de los Sistemas de Producción y Recursos Naturales, INTA, Proyecto Disciplinar I208 Diseño e Implementación de un Sistema de Medición de Impacto del INTA sobre el SAAA, Argentina, ISSN 1851-6955, N.º 18, 2020.

Curarello, P. A.: “Introducción al enfoque de la evaluación de impacto: guía para proyectar procesos de creación de impacto y su medición”, en Serie Estudios Socioeconómicos de la Sustentabilidad de los Sistemas de Producción y Recursos Naturales, INTA, Proyecto Disciplinar I208 Diseño e Implementación de un Sistema de Medición de Impacto del INTA sobre el SAAA, Argentina, ISSN 1851-6955, N.º 20, 2021.

De Rham, P., y Mancero, L.: “Monitoreo y evaluación de acciones de desarrollo orientadas al impacto”, Serie Metodologías, Secretaría Técnica de Agricultura Sostenible Campesina de Montaña-Intercooperation (auspicia Agencia Suiza para el Desarrollo y la Cooperación), Quito, Ecuador, 2009.

Estébanez, M. E.: Taller de indicadores de evaluación de bibliotecas: impacto de la ciencia y la tecnología en la sociedad actual, estrategias de medición, REDES, Centro de Estudios sobre Ciencia Desarrollo y Educación Superior, La Plata, Argentina, 2007.

Fernández de Castro Fabre, A.: Análisis de la medición del impacto sobre el desarrollo local en los proyectos de investigación de la Universidad Agraria de La Habana (UNAH), tesis presentada en opción del título de Máster en Desarrollo Agrario Rural, La Habana, Cuba, 2010.

Fernández L. J.: Método de evaluación de resultados de incidencia del diálogo de políticas: jóvenes rurales y su territorio, una estrategia de diálogo de políticas, Centro Latinoamericano para el Desarrollo Rural (RIMISP), Fondo Internacional de Desarrollo Agrícola, Centro Latinoamericano de Desarrollo Rural, Chile, 2017.

Ferraz, C.: “Curso Teoría de Cambio: indicadores y medición del impacto”, Pontificia Universidad Católica de Río de Janeiro. Abdul Latif Jameel Poverty Action Lab., 2019.

Fondo Internacional de Desarrollo Agrícola (FIDA): “Oficina de Evaluación Independiente del FIDA”, Manual de Evaluación, segunda edición, Roma, 2015.

Fundación CIGOB (Ciencias para Gobernar): “Guía metodológica de medición de impacto. Metodología CIGOB-Matus. Procesamiento de problemas públicos”, Guía Metodológica para el Diseño de una Estrategia de Intervención sobre Problemas Gubernamentales, obtenido en: https://cigob.org.ar/cigob/wp-content/uploads/2015/06/Guia-metodologicaCiGob-Matus.pdf.

Funnell, S., y Rogers, P.: Teoría del programa con propósito: uso efectivo de teorías de cambio y modelos lógicos, San Francisco, California, John Wiley & Sons, 2011.

Gault, A., y Ceballos, A.: “Capítulo Cuarto. Evaluación de resultados e impacto en los proyectos científicos y tecnológicos: retos y necesidades. El caso de los fondos sectoriales y mixtos”, obtenido en: https://archivos.juridicas.unam.mx/www/bjv/libros/5/2148/9.pdf.

Gertler, P. J.; Martínez, S.; Premand, P.; Rawlings, L. B., y Vermeersch, C. M. J.: La evaluación de impacto en la práctica, Banco Interamericano de Desarrollo y Banco Mundial, doi:10.1596/978-1-4648-0888-3, licencia de atribución: Creative Commons CC BY 3.0 IGO, segunda edición, Washington D. C., 2017.

Guidoccio, A.; Borrmann, R.; Gamarnik, L.; Arias, E.; Donoso, R.; Benítez, R,; Ol Beun, J.; Purita, L.; Munilla, F.; Pérez, D., y Larsen, N.: Kit de evaluación: herramientas para una gestión ágil. Teoría de Cambio y pensamiento evaluativo, Ministerio de Modernización, Subsecretaría de Innovación Pública y Gobierno Abierto, Presidencia de la Nación, Ciudad Autónoma de Buenos Aires, Argentina, 2018.

Hehenberger, L.; Harling, A-M., y Scholten, P.: A practical guide to measuring and managing impact, editada por Asociación Española de Fundaciones, European Venture Philanthropy Association, España, 2013.

Huertas, F.: “El Método PES”, entrevista a Carlos Matus, CEREB, Altadir Ed., 2006, Universidad Nacional de La Matanza, La Matanza, Argentina, 1979.

Impact Hub: Manual de medición de impacto social, Madrid, España, 2015.

Jefatura de Gabinete de Ministros: Manual de base para la evaluación de políticas públicas, segunda edición, Programa de Evaluación de Políticas Públicas, Jefatura de Gabinete de Ministros de la Nación y Ministerio de Modernización, Buenos Aires, Argentina, 2016.

Jensen, L. – The Write Way Inc.: Manual sobre la gestión basada en resultados: la labor conjunta basada en la niñez, UNICEF, Nueva York, Estados Unidos, 2017.

Leeuw, F., y Vaessen, J.: Impact evaluations and development NONIE guidance on impact evaluation, The Network of Networks on Impact Evaluation (NONIE), Frans Leeuw y Jos Vaessen, c/o Independent Evaluation Group, Washington D. C., 2009.

Lema, D.: Introducción a métodos para estimación de impacto económico, INTA-Instituto de Economía y Sociología (IES), Ciudad Autónoma de Buenos Aires, Argentina, 2014.

Lema, D.: Taller Proyecto Evaluación de Impacto de Tecnologías y del Cambio Tecnológico: Componente Evaluación de Impacto Ex–post, INTA, Ciudad Autónoma de Buenos Aires, Argentina, 2020.

Mantilla, R. V.: “Hacia un nuevo enfoque de la evaluación de impacto de proyectos de desarrollo rural”, Cuadernos de Desarrollo Rural (50), Facultad de Estudios Ambientales y Rurales de la Pontificia Universidad Javeriana de Bogotá, Colombia, 2003.

Marco de Asistencia de las Naciones Unidas para el Desarrollo entre el Gobierno de la República Dominicana y el Sistema de las Naciones Unidas: Sistema de las Naciones Unidas en República Dominicana, 2017.

Mayne, J.: Contribution analysis: an approach to exploring cause and effect, Institutional Learning and Change Initiative Methodological Brief, disponible en: http://www.cgiar-ilac.org/files/ILAC_Brief16_Contribution_Analysis_0.pdf. Better Evaluation, 2011. Análisis de contribución (Contribution analysis). Traducido de inglés a español por María Susana Carrera Risco, 2008. En: https://ww.betterevaluation.org/approach/analisis-de-contribucion. Ministerio Federal de Cooperación Económica y Desarrollo de Alemania.

Medina, F. H.: “Taller de Evaluación de Impacto de Políticas Públicas”. Políticas Presupuestales y Gestión por Resultados, Comisión Económica para América Latina y el Caribe-Instituto Latinoamericano de Planificación Económica y Social, Santiago de Chile, 2005.

Millán, N.; Barth, I., y Varela, M.: “Taller de indicadores”, Dirección Nacional Asistente Investigación, Desarrollo y Planificación Gerencia de Monitoreo y Evaluación, INTA, Ciudad Autónoma de Buenos Aires, Argentina, 2020.

Monroy Varela, S. E.: Evaluación de impacto ex ante de proyectos de investigación. Caso: Proyectos Financiados por Colciencias en Malaria en el Programa de Ciencia y Tecnología de la Salud, Facultad de Ingeniería, Universidad Nacional de Colombia, Bogotá, 2017.

Moñux Chércoles, D.; Aleixandre Mendizábal, G.; Gómez González, F. J., y Miguel González, L. J.: Evaluación del impacto social de proyectos de I+D+i: guía práctica para centros tecnológicos, Centro de Automatización, Robótica, Tecnología de la Información y de la Fabricación, y Departamento de Ingeniería de Sistemas y Automática, Universidad de Valladolid, Valladolid, España, 2003.

Moreno, A.; Kondakjian, A.; Ferraro, A.; Finkelstein, J.; Sara Ovadia, J. E., y Choconi, R. G., por Secretaría de Gobierno de Ambiente y Desarrollo Sustentable, y Castelli, M.J., y Tinelli, M.L., por Acrux: Manual de métricas e indicadores para emprendimientos sustentables: ¿por qué y cómo medir el impacto ambiental y social de tu emprendimiento?, Programa Nacional de Emprendedores para el Desarrollo Sustentable, Secretaría de Ambiente y Desarrollo Sustentable, Ciudad Autónoma de Buenos Aires, Argentina, 2019.

Navarro, H.: Manual para la evaluación de impacto de proyectos y programas de lucha contra la pobreza, Instituto Latinoamericano y del Caribe de Planificación Económica y Social (ILPES), Área de Proyectos y Programación de Inversiones Manuales 41, Comisión Económica para América Latina y el Caribe (CEPAL), Santiago de Chile, 2005.

Navarro, H.; King, K.; Ortegón, E., y Pacheco J. F.: Pauta metodológica de evaluación de impacto ex ante y ex post de programas sociales de lucha contra la pobreza: aplicación metodológica, Instituto Latinoamericano y del Caribe de Planificación Económica y Social (ILPES), Área de Proyectos y Programación de Inversiones, Comisión Económica para América Latina y el Caribe (CEPAL), Santiago de Chile, 2006.

Novo da Gloria Dias, R.: Evaluación del impacto de los graduados de la carrera de Economía del municipio Urbano Noris en su actividad laboral, Universidad de Holguín Oscar Lucero Moya, Ciudad de Holguín, Cuba, 2010.

Oficina de las Naciones Unidas contra la Droga y el Delito: Manual para gestión basada en resultados y la Agenda 2030 para el Desarrollo Sostenible, Programa de las Naciones Unidas para el Desarrollo (PNUD), Viena, 2018.

Peersman, G.: Evaluación de impacto: mejor evaluación, 2015. Obtenido de http://www.betterevaluation.org/themes/impact_evaluation.

Pefile S.: “Monitoreo, evaluación y valoración del impacto”. En Gestión de la propiedad intelectual e innovación en agricultura y en salud: un manual de buenas prácticas (eds. Español: P. Anguita, F. Díaz, C. L. Chi-Ham et al.). Fundación para la Innovación Agraria (FIA), Programa FIA-Public Intellectual Property Resource for Agricultura (PIPRA) (Chile) y PIPRA (Estados Unidos), 2010. Disponible en línea: http://fia.pipra.org.

Rawlings, L. B.: Taller “El rol del monitoreo en la evaluación de impacto”, Lima. Perú, 2009.

Retolaza, I.: “Facilitating a Theory of Change workshop in Central America: a personal reflection”, Learning Report, Taller “Práctica orientada hacia resultados en el aprendizaje y la rendición de cuentas”, San José de Costa Rica, 2009.

Robin, S., y García, B.: Luces y sombras de la medición del impacto social en España: el estado de la medición y gestión del impacto social en España. ESIMPACT, España, 2019.

Rodríguez San Julián, E; Boni, A.; Arias, B.; Ballesteros J. C., y Megías, I.: Evaluación ex ante en educación para el desarrollo: una propuesta de indicadores en el ámbito formal, Agencia Española de Cooperación Internacional al Desarrollo (AECID), Valencia, España, 2014.

Rogers, P.: “Sinopsis: estrategias de atribución causal”, Síntesis Metodológica N.º 6, Centro de Investigaciones de UNICEF, Florencia, 2014.

Rogers, P.: “Sinopsis de la evaluación de impacto”, Síntesis Metodológica N.º 1, Centro de Investigaciones de UNICEF, Florencia, 2014.

Rogers, P.; Hawkins, A.; McDonald, B.; Macfarlan, A., y Milne, C.: Choosing appropriate designs and methods for impact and devaluation, Australian Government, Department of industry, Innovation and Science, Australia, 2015.

Sánchez Fernández, J. L.: Evaluación de impacto de los graduados de la Carrera de Economía en su actividad laboral en el Municipio de Mayarí, Universidad de Holguín Oscar Lucero Moya, Ciudad de Holguín, Cuba, 2009.

Sanz Cañada, E.; García del Río, F. J.; Villalvilla Asenjo, H.; Brotons López, E., y Mate Corrales, D.: “Estudio de Impacto Territorial del Plan General Municipal de Ordenación de San Javier”, Estudios, Proyectos y Planificación, S.A. (EPYPSA), Ayuntamiento de San Javier, 2014.

Serrano, E.; Herrera, M.; Martínez, A, y Simón, J., y Díaz, A.: Bases para la evaluación de impacto de políticas públicas, Instituto Andaluz de Administración Pública (IAAP), Sevilla, España, 2018.

Stern, E. (team leader); Stame, N.; Mayne, J.; Forss, K., y Davies, R.: Working Paper 38. Broadening the range of designs and methods for impact evaluations, informe de un estudio encargado por el Department for International. Development (DFID), Barbara Befani, Londres, 2012.

Stichting Nederlandse Vrijwilligers (SNV): Measuring impact – Metodología de Medición de Impacto Social. SNV en América: www.snvla.org/measuringimpact, Consejo Mundial Empresarial para el Desarrollo Sostenible: www.wbcsd.org/web/measuringimpact.

Trujillo, R.; Gómez, A., y Canales, R.: Midiendo el valor del impacto social empresarial: guía de herramientas de medición y valoración del impacto social empresarial, Clúster de Impacto Social-Forética, España, 2020.

Vanclay, F.; Esteves, A. M.; Aucamp, I., y Franks, D. M.: Evaluación de impacto social: lineamientos para la evaluación y gestión de impactos sociales de proyectos, Asociación Internacional para la Evaluación de Impactos, Banco Interamericano de Desarrollo (BID), 2015. Disponible en www.iaia.org.

Vara-Horna, A.: La evaluación de impacto de los programas sociales: fundamentos teóricos y metodológicos y aplicación al caso peruano, Lima, Fondo Editorial de la Universidad de San Martín de Porres, 2007.

Vedovoto, G.: Tesis doctoral “Evaluación multidimensional de los impactos de las innovaciones tecnológicas: resultados obtenidos a partir de diferentes aproximaciones metodológicas”, Barcelona, España, 2013.

Vigo, V.; Vigil, S.; Sánchez, M., y Medianero, D.: Manual de monitoreo y evaluación de proyectos de desarrollo sostenible, Asociación Los Andes de Cajamarca, David Medianero Burga, Cajamarca, Perú, 2018.

Watson, C.: Literature review of impact measurement in the humanitarian sector, Centro Internacional Feinstein, Medford, 2008.

Weyrauch, V.: “Documento de trabajo grupos diálogo rural: impactos a gran escala. Eslabones de incidencia. Una metodología para registrar la incidencia en políticas de RIMISP”, Fondo Internacional de Desarrollo Agrícola (FIDA), Centro Latinoamericano de Desarrollo Rural, Chile, 2014.

Winchester, L.: “Curso Internacional en Planificación Estratégica y Políticas Públicas. Políticas públicas: formulación y evaluación”, Instituto Latinoamericano y del Caribe de Planificación Económica y Social (ILPES)-Comisión Económica para América Latina y el Caribe (CEPAL), Agencia Española de Cooperación Internacional para el Desarrollo (AECID), La Antigua, Guatemala, 2011.

Winters, P.; Salazar, L., y Maffioli, A.: “Designing impact evaluations for agricultural projects: impact-evaluation guidelines”, Technical Notes N.º IDB-TN-198, Oficina de Planificación Estratégica y Eficacia en el Desarrollo, Banco Interamericano para el Desarrollo (BID), Washington D. C., 2010.

Winters, P., y Rubio, S. S.: “Evaluating the impact of regional development programs: impact-evaluation guidelines”, Technical Notes N.º IDB-TN-157. Oficina de Planificación Estratégica y Eficacia en el Desarrollo, Banco Interamericano para el Desarrollo (BID), Washington D. C., 2010.

Anexo

Cuadro 1. Evaluación de impacto (EI): referencias bibliográficas por tema

Tema | Referencia bibliográfica |

¿Por qué evaluar? ¿Para qué? ¿Por qué? ¿Qué es evaluar? | Aldunate, 2010; Arenas Caruti, 2019; Baker, 2000; Barret et al., 2018; Chavarría Miranda, 2018; Curarello, 2021; Curarello et al., 2020; FIDA, 2015; Gertler et al., 2017; Guidoccio, 2018; Jefatura de Gabinete de Ministros, 2016; Jensen, 2017; Leeuw y Vaessen, 2009; Medina, 2005; Navarro, 2005; Navarro et al., 2006; Hehenberger et al., 2013; Robin y García, 2019; Rodríguez San Julián et al., 2014; Serrano et al., 2018; UNODC, 2018; Vara Horna, 2007; Vigo et al., 2018; Winchester, 2011. |

¿Qué es el impacto? ¿En qué consiste una evaluación de impacto? ¿Cómo se hace esto? ¿Cómo diseñar (o rediseñar) el “proyecto” de intervención para poder medir impacto? | Aldunate, 2010; Arenas Caruti, 2019; Ávila y Sain, 2007; Barret et al., 2018; Bello, 2009; Blasco y Casado, 2009; Baker, 2000; CNCPS PNA, 2019; Curarello, 2020 y 2021; Curarello et al., 2020; Demel et al., 2008; Fernández de Castro Fabre, 2010; Ferraz, 2019; FIDA, 2015; Gertler et al., 2017; Impact Hub, 2015; Jefatura de Gabinete de Ministros, 2016; Leeuw y Vaessen, 2009; Lema, 2014 y 2020; Mantilla, 2003; Medina, 2005; Millán et al., 2020; Monroy Varela, 2017; Moñux Chércoles et al., 2003; Morales, 2017; Moreno et al., 2019; Navarro, 2005; Navarro et al., 2006; Robin y García, 2019; Rodríguez San Julián et al., 2014; Rogers, 2014a; Serrano et al., 2018; Trujillo et al., 2020; UNODC, 2018; Vanclay et al., 2015; Vara Horna, 2007; Vigo et al., 2018; Weyrauch, 2014; Winchester, 2011. |

Gestión por impacto Requisitos. Enfoques complementarios. Consideraciones éticas. | Aldunate, 2010; Arenas Caruti, 2019; Ávila y Sain, 2007; Blasco y Casado, 2009; Baker, 2000; Barret et al., 2018; Chambers et al., 2009; Curarello, 2021; Curarello et al., 2020; Demel et al., 2008; Fernández de Castro Fabre, 2010; Ferraz, 2019; FIDA, 2015; Gertler et al., 2017; Hehenberger et al., 2013; IFC, 2015; Impact Hub, 2015; Leeuw y Vaessen, 2009; Mantilla, 2003; Medina, 2005; Millán et al., 2020; Moñux Chércoles et al., 2003; Moreno et al., 2019; Robin y García, 2019; Rogers, 2014a; Serrano et al., 2018; Trujillo et al., 2020; UNODC, 2018; Vanclay et al., 2015; Vedovoto, 2013; Vigo et al., 2018; Weyrauch, 2014; Winchester, 2011. |

¿Es la EI la mejor manera de responder a las preguntas de evaluación que motivan el estudio? | Aldunate, 2010; Arenas Caruti, 2019; Baker, 2000; CNCPS-PNA, 2019; Curarello, 2021; FIDA, 2015; Gertler et al., 2017; Impact Hub, 2015; Medina, 2005; Navarro et al., 2006; Rogers, 2014a; Serrano et al., 2018; Vara Horna, 2007; Vigo et al., 2018; Winchester, 2011. |

La EI en las decisiones de política La decisión de llevar a cabo (o continuar con) una EI. | Arenas Caruti, 2019; Baker, 2000; Blasco y Casado, 2009; Curarello, 2021; Fernández de Castro Fabre, 2010; FIDA, 2015; Gertler et al., 2017; Hehenberger et al., 2013; Medina, 2005; Rogers, 2014a; Serrano et al., 2018; UNODC, 2018; Vara Horna, 2007; Vigo et al., 2018. |

La pregunta de EI ¿Cuál es la pregunta (específica) de causa-efecto que se quiere responder? | Aldunate, 2010; Arenas Caruti, 2019; Baker, 2000; Barret et al., 2018; Bello, 2009; Blasco y Casado, 2009; CNCPS-PNA, 2019; Curarello, 2020; Curarello, 2021; Demel et al., 2008; Fernández de Castro Fabre, 2010; Ferraz, 2019; FIDA, 2015; Gertler et al., 2017; Hehenberger et al., 2013; Huertas, 1979; Impact Hub, 2015; Leeuw y Vaessen, 2009; Lema, 2014 y 2020; Navarro et al., 2006; Mantilla, 2003; Monroy Varela, 2017; Moñux Chércoles et al., 2003; Moreno et al., 2019; Rogers, 2014a; Serrano et al., 2018; UNODC, 2018; Vara Horna, 2007; Vedovoto, 2013; Vigo et al., 2018; Weyrauch, 2014. |

Indicadores de impacto | Ávila y Sain, 2007; Baker, 2000; Barret et al., 2018; Bello, 2009; Curarello, 2021; Demel et al., 2008; Ferraz, 2019; FIDA, 2015; Medina, 2005; Navarro, 2005; Fernández de Castro Fabre, 2010; Gertler et al., 2017; Hehenberger et al., 2013; IFC, 2015; Jensen, 2017; Leeuw y Vaessen, 2009; Moñux Chércoles et al., 2003; Moreno et al., 2019; Navarro et al., 2006; Rodríguez San Julián et al., 2014; Rogers, 2014a; Serrano et al., 2018; Trujillo et al., 2020; UNODC, 2018; Vara Horna, 2007; Vedovoto, 2013; Vigo et al., 2018; Weyrauch, 2014. |

EI prospectivas y retrospectivas, anticipando y no anticipando los efectos | Arenas Caruti, 2019; Baker, 2000; Curarello, 2021; Curarello et al., 2020; FIDA, 2015; Gertler et al., 2017; Hehenberger et al., 2013; Huertas, 1979; Jefatura de Gabinete de Ministros, 2016; Leeuw y Vaessen, 2009; Medina, 2005; Monroy Varela, 2017; Moreno et al., 2019; Navarro, 2005; Navarro et al., 2006; Novo da Gloria Dias, 2010; Rodríguez San Julián et al., 2014; Rogers, 2014a y 2014b; Rogers et al., 2015; Sánchez Fernández, 2009; Serrano et al., 2018; Vanclay et al., 2015; Vedovoto, 2013; Weyrauch, 2014. |

Escenarios de atribución causal (exclusiva, conjunta y múltiples) | Baker, 2000; Barret et al., 2018; Bello, 2009; Better Evaluation, 2011; Catley et al., 2007; Curarello, 2021; Curarello et al., 2020; Huertas, 1979; Leeuw y Vaessen, 2009; Mayne, 2008; Navarro et al., 2006; Rogers, 2014a y 2014c; Rogers et al., 2015; Serrano et al., 2018; Vanclay et al., 2015; Vigo et al., 2018; Weyrauch, 2014. |

Estrategias de atribución causal: – Enfoques contrafácticos. – Análisis de la coherencia de las pruebas empíricas con la relación causal. – Descarte de explicaciones alternativas. | Baker, 2000; Barret et al., 2018; Bello, 2009; Better Evaluation, 2011; Blasco y Casado, 2009; Catley et al., 2007; Curarello, 2021; Curarello et al., 2020; Federación Internacional de Sociedades de la Cruz Roja y de la Mayne, 2008; Media Luna Roja, 2011; Ferraz, 2019; FIDA, 2015; Gertler et al., 2017; Leeuw y Vaessen, 2009; Lema, 2014 y 2020; Medina, 2005; Navarro, 2005; Navarro et al., 2006; Rogers, 2014a y 2014c; Rogers et al., 2015; Serrano et al., 2018; Vara Horna, 2007; Vigo et al., 2018; Weyrauch, 2014. |

El equipo de EI: roles y responsabilidades | Arenas Caruti, 2019; Baker, 2000; Curarello, 2021; Curarello et al., 2020; FIDA, 2015; Gertler et al., 2017; Navarro et al., 2006; Rogers, 2014a; Rogers et al., 2015. |

- “Investigación, desarrollo e innovación”.↵